龙哥读论文学术交流群(知识星球)来了!

想了解最新最快最好的CV/DL/ML/LLM论文速递、优质开源项目、学习教程和实战训练等资料,欢迎扫描下方二维码,加入龙哥读论文交流群,连续入选知识星球新星榜!

龙哥推荐理由:

这篇来自深圳大学的论文,巧妙地将时下热门的Mamba模型与经典U-Net结构结合,并创造性地引入了“多感知”融合模块。它不仅解决了高光谱重建中单一感知的瓶颈,还在精度和计算效率之间取得了出色的平衡。方法设计清晰、实验充分,代码也已开源,是底层视觉领域一个非常扎实且具有启发性的工作。

原论文信息如下:

论文标题:

M3SR: Multi-Scale Multi-Perceptual Mamba for Efficient Spectral Reconstruction

发表日期:

2026年01月

发表单位:

深圳大学计算机与软件工程学院,深圳技术大学人工智能学院

原文链接:

https://arxiv.org/pdf/2601.08293v1.pdf

开源代码链接:

https://github.com/zhangyuzecn/M3SR

想象一下,你的手机摄像头突然拥有了“超级视力”——不仅能拍下眼前的景象,还能瞬间分析出画面里每样东西的化学组成、水分含量甚至健康状态。这听起来像科幻,但这正是高光谱成像(Hyperspectral Imaging)试图为我们带来的能力。

传统RGB相机用红绿蓝三个通道记录世界,而高光谱相机则用几十甚至上百个连续的窄波段“看清”物体反射或发射的光谱特征。这项技术在环境监测、精准农业、医疗诊断等领域潜力巨大。

但问题来了:专业的高光谱相机又贵又笨重,不适合日常使用。于是,研究人员想了个“曲线救国”的办法:从普通的RGB图像里,“猜”出它对应的高光谱图像。这个任务就叫光谱重建(Spectral Reconstruction, SR)。

这就像给你一张黑白照片,让你脑补出它原本的彩色样子,而且还得是包含了紫外线、红外线等不可见光的“超级彩色”。难吧?🤨

近年来,Transformer模型在这个任务上表现不错,因为它能捕捉图像中远处的像素关系。但它有个老毛病:计算量随着图像尺寸暴增,对于高分辨率的高光谱图像来说,实在太“烧钱”了。

图:M3SR重建的高光谱图像(右)与真实值(中)的绝对误差对比。蓝色越深,说明重建得越准。

Mamba遇上高光谱重建:单感知的瓶颈在哪?

就在Transformer为计算量发愁时,一个叫Mamba的新星在NLP领域崛起了。它基于状态空间模型(State Space Model, SSM),能以线性复杂度处理超长序列,性能和Transformer差不多,但效率高得多!

很快,视觉领域的Mamba(比如VMamba)也出现了,大家惊喜地发现,它在图像分类、分割等任务上也能打。于是,有人开始尝试把Mamba用到光谱重建上。

瓶颈一:单感知的“偏科”Mamba的核心是处理一维序列。用在图像上,它主要擅长捕捉空间上的长距离依赖关系(比如图像左上角和右下角物体的关联)。但高光谱图像是三维数据块(空间宽度×空间高度×光谱维度)!它不仅有丰富的空间纹理,还有沿着光谱维度连续变化的特征。只盯着空间关系看,就像只用耳朵听交响乐,忽略了乐谱和乐器的色彩,无法全面“理解”这首曲子。

瓶颈二:单尺度的“短视”很多Mamba方法是单尺度提取特征。但图像信息是分层次的:全局轮廓、物体部件、局部细节(比如叶脉、织物纹理)。单尺度特征提取很难同时把握“大局观”和“微表情”,在重建复杂的高光谱图像时,容易顾此失彼。

深圳大学和深圳技术大学的团队敏锐地捕捉到了这些问题,并提出了一个漂亮的解决方案:M3SR。

多尺度多感知Mamba(M3SR)如何破局?

M3SR这个名字就直击要害:Multi-Scale(多尺度)和 Multi-Perceptual(多感知)。它的整体架构非常清晰,基于经典的U-Net,但“芯”换成了自家的秘密武器。

图3:M3SR的整体架构(上)和其核心——多感知融合块(MPF)的详细结构(下)。它像是一个由多个专家组成的“顾问团”,各自从不同角度分析图像。

多尺度是怎么实现的?答案就是U-Net的编码器-解码器结构。输入图像经过多次下采样,特征图越来越小,感受野越来越大,这就捕捉到了全局尺度的语义信息(比如:这是一片森林)。然后通过上采样和跳跃连接,逐步恢复空间细节,同时结合编码过程中提取的中间尺度(一棵棵树)和局部尺度(一片片叶子)的特征。

那多感知的魔法又藏在哪呢?这就全靠那个被塞进U-Net每一层的多感知融合块(Multi-Perceptual Fusion Block, MPF)了。它才是M3SR真正的“大脑”。

核心组件解析:多感知融合(MPF)块

MPF块内部有三条并行的“专家流水线”,分别从空间、频率和光谱三个维度来感知和理解输入特征。

这一支是Mamba的“本职工作”。它使用了一个名为VSS块(Visual State Space block)的模块,其核心是二维选择性扫描(SS2D)。简单说,SS2D会把2D图像特征沿着水平、垂直等四个方向“拉直”成1D序列,然后用Mamba的高效选择性状态空间模型(S6)分别处理这些序列,最后再合并回来。这样,它就能以线性复杂度捕捉图像中任意两个像素间的空间长程依赖。

这是本文一个非常巧妙的创新点!图像处理中,空间域看像素的明暗变化,频率域则看变化的快慢(频率)。平缓的背景是低频,锐利的边缘和细腻的纹理是高频。

图2:离散小波变换(DWT)将一幅图像分解为一个低频近似子带(LL,包含主要轮廓)和三个方向的高频细节子带(LH, HL, HH,包含边缘纹理)。这就像把一幅画分解成了“轮廓草图”和“细节笔触”。

MPF的频率分支就利用了离散小波变换(Discrete Wavelet Transform, DWT)。它把输入特征图分解成四个子带(一个低频,三个不同方向的高频)。然后,对每个子带分别用前面提到的VSS块进行处理(让Mamba去理解频率信息的全局关系),最后再用逆离散小波变换(IDWT)合成回来。这样做的好处是,模型可以显式地、有针对性地处理不同频率的信息,对于恢复高光谱图像中至关重要的纹理细节帮助极大。

这是专门针对高光谱数据特性的设计。对于一个像素点,它在31个光谱通道上的数值,可以看作一个一维序列(波长从400nm到700nm连续变化)。Mamba处理这种序列正是拿手好戏!

这一分支将输入特征在通道维度上进行分组,对每一组应用标准的Mamba块(图4b),专门用来建模不同波长之间的依赖关系。例如,植物在特定波段的吸收峰会影响邻近波段的反射率,这个分支就能捕捉到这种光谱连续性。

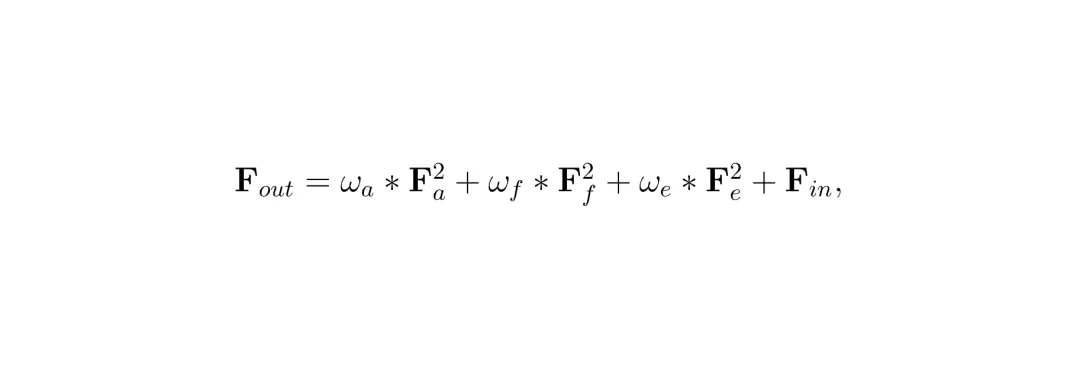

三条分支各司其职,提取到的特征如何融合呢?M3SR采用了一种自适应加权融合的方式。三个可学习的权重参数 ωa, ωf, ωe 分别对应空间、频率、光谱特征的重要性,在训练中自动调整。最后,再加上一个残差连接,确保网络稳定训练。

至此,一个能从多角度、多层次“理解”图像的强大模块就构建完成了。把它嵌入U-Net的每一层,让模型在提取不同尺度特征时,都能进行这种全方位的感知分析。

至此,一个能从多角度、多层次“理解”图像的强大模块就构建完成了。把它嵌入U-Net的每一层,让模型在提取不同尺度特征时,都能进行这种全方位的感知分析。

实验结果:精度与效率的双重领先

设计得再漂亮,也得靠实验结果说话。论文在四个公开高光谱重建数据集(NTIRE2022, CAVE, NTIRE2020-Clean, NTIRE2020-Realworld)上,与10个SOTA方法进行了全面对比。

评估指标包括衡量数值精度的RMSE(均方根误差,越低越好)和PSNR(峰值信噪比,越高越好),衡量光谱保真度的SAM(光谱角制图,越低越好),以及衡量结构相似度的MSSIM(平均结构相似性,越高越好)。

图1:一张图看懂M3SR的“性价比”。横轴是计算量(FLOPs,越左越好),纵轴是质量(PSNR,越高越好),圆圈大小是参数量(越小越好)。M3SR(我们的)稳稳地坐在了左上角——用相对少的计算和参数,拿到了最高的质量。这平衡感绝了!

表1:在NTIRE2022和CAVE数据集上的结果。M3SR在NTIRE2022的所有指标(RMSE, PSNR, MSSIM)上都取得了第一,在CAVE数据集的RMSE和PSNR上也拔得头筹。注意看参数量(Params)和计算量(FLOPs),M3SR并非最小,但相比性能接近的MST++等Transformer方法,它的计算成本(100.9G FLOPs vs 177.7G)有显著优势。

表2:在NTIRE2020数据集上的结果。在Clean数据集上,M3SR实现了所有指标的全面第一。在更具挑战性的Realworld数据集上,也拿下了RMSE、PSNR和MSSIM三个关键指标的第一。

图5:这是重建结果与真实值之间的绝对误差热力图。蓝色越深,误差越小,重建得越准。可以明显看到,M3SR的结果图(最右)蓝色区域最大、最深,说明其重建误差整体最小、最均匀,尤其是在图像中央的纹理复杂区域,优势明显。消融实验:每个感知分支都不可或缺

为了验证MPF块中三条分支是否真的都起作用,论文做了详细的消融实验。

表3:分别移除空间(M3SR-V1)、频率(M3SR-V2)和光谱(M3SR-V3)分支后,性能全面下降。这强有力地证明了“多感知”设计的必要性:

去掉空间分支:模型“看不懂”物体形状和布局,PSNR和RMSE恶化严重,光谱角误差(SAM)暴增,说明空间结构一塌糊涂。

去掉频率分支:模型失去了处理纹理细节的“利器”,PSNR和结构相似性(MSSIM)明显下降,重建结果变得模糊。

去掉光谱分支:模型无法理解颜色(光谱)随波长的连续变化,导致在所有指标上都有可观的性能损失。

此外,论文还对光谱分支中的分组数G进行了调参,发现G=4时能在性能和计算开销间取得最佳平衡(表4)。

总结与展望:Mamba在底层视觉的更多可能

深圳大学团队的这项工作,可以看作是将Mamba成功引入底层视觉任务(尤其是高光谱重建)的一个典范。

它没有简单地堆砌Mamba层,而是深刻分析了任务特性与模型瓶颈,提出了“多感知融合”这一核心思想,并巧妙地用小波变换开辟了频率感知的新路径。结合经典的U-Net实现多尺度分析,最终实现了精度和效率的“双赢”。

这项研究给我们带来很多启发:未来,Mamba这类高效序列模型在图像修复、去噪、超分等其他底层视觉任务中,结合特定的领域知识(如频率分析、物理模型)进行“感知增强”,可能会催生出更多高性能、低功耗的实用模型。

龙迷三问

这篇论文解决的核心问题是什么?它解决的是如何从一张普通的RGB彩色照片,高质量、高效率地重建出对应的高光谱图像(包含数十个连续窄波段信息)。传统方法和一些基于Transformer的模型要么精度不够,要么计算成本太高。本文用Mamba模型来解决效率问题,并创新性地提出了“多感知融合”模块来攻克精度瓶颈。

Mamba到底是什么?和Transformer比有何优劣?Mamba是一种基于状态空间模型(SSM)的新型序列模型。你可以把它理解为Transformer的一个高效竞争者。优势:处理长序列时,计算复杂度是线性的(Transformer是平方级的),因此效率极高,特别适合高分辨率图像。它还有一个“选择性”机制,能动态关注重要信息。劣势:作为较新的架构,其在各种视觉任务上的潜力和最佳应用方式仍在探索中,不像Transformer那样有成熟的生态和套路。

高光谱图像具体有什么用?能举个生活化的例子吗?用处非常大!比如在农业上,通过分析作物叶片的光谱,可以判断其缺水、缺氮还是生病了,实现精准灌溉和施肥。在环保领域,可以用无人机搭载高光谱相机监测水体污染程度、藻类爆发。在医疗上,可以帮助医生区分肿瘤组织和正常组织。甚至在艺术品鉴定中,可以无损分析画作的颜料成分和历史层次。它让机器拥有了超越人眼的“物质分析”能力。

如果你还有哪些想要了解的,欢迎在评论区留言或者讨论~龙哥点评

论文创新性分数:★★★★☆

将Mamba用于光谱重建不是首创,但提出“多感知融合”概念,并首创性地结合空间Mamba、小波变换(频率)和光谱Mamba三个分支,设计思路清晰且有新意。尤其是在频率域引入小波变换+DWT/IDWT的处理方式,非常巧妙。实验合理度:★★★★★

实验非常充分。在四个主流数据集上与10个SOTA方法对比,涵盖数值误差、光谱保真、结构相似性和计算效率多个维度。消融实验完整证明了每个组件的有效性,参数分析也到位。对比公平,结论可信。学术研究价值:★★★★☆

为Mamba在底层视觉任务中的应用提供了一个优秀范例。其“多感知”设计哲学可以迁移到其他图像恢复、增强任务中。开源代码也促进了领域内的复现和后续研究。启发性强。稳定性:★★★★☆

基于U-Net和Mamba块构建,结构稳定。使用了残差连接和自适应加权融合,训练过程应较稳定。在多个不同特性的数据集(Clean/Realworld)上表现一致,鲁棒性较好。适应性以及泛化能力:★★★★☆

方法针对高光谱重建任务设计,但其多尺度U-Net骨架和多感知融合的思想具有一定通用性。是否能直接用于自然图像超分、去噪等任务,需要针对性的适配和验证。硬件需求及成本:★★★★☆

计算量(100G FLOPs级别)相比SOTA Transformer模型显著降低,但仍需要GPU进行训练和高效推理。对于实时性要求极高的移动端部署,可能还需进一步轻量化。复现难度:★★★★★

论文方法描述清晰,代码已在GitHub开源,复现难度低。数据集的获取和处理方式在论文中也有明确说明,便于跟进研究。产品化成熟度:★★★☆☆

作为学术研究,性能已达到SOTA,且效率有优势。但要产品化集成到手机或专业设备中,仍需解决模型固化、与相机ISP(图像信号处理器) pipeline整合、特定场景优化(如暗光、动态场景)等工程问题。可能的问题:论文整体扎实,但“多感知”中空间与频率分支均使用VSS块,一定程度存在结构冗余。另外,自适应权重的学习过程及其可解释性可进一步探讨。整体来说,这是一篇高质量的工作。[1] Gu, A., & Dao, T. (2023). Mamba: Linear-time sequence modeling with selective state spaces.[2] Liu, Y., et al. (2024). VMamba: Visual State Space Model.[3] Ronneberger, O., Fischer, P., & Brox, T. (2015). U-net: Convolutional networks for biomedical image segmentation.[4] Arad, B., et al. (2020, 2022). NTIRE spectral reconstruction challenge and datasets.[5] Cai, Y., et al. (2022). MST++: Multi-stage spectral-wise transformer for efficient spectral reconstruction.龙哥读论文学术交流群(知识星球)来了!每日提供最新最快最好的CV/DL/ML/LLM论文速递、优质开源项目、学习教程和实战训练等资料!想第一时间看懂像M3SR这样巧妙融合多感知、多尺度的前沿工作?想高效追踪底层视觉领域的最新进展?扫码加入「龙哥读论文」知识星球,让论文解读像看短视频一样轻松,前沿干货、实用资源一站式拿捏~