近年来,深度伪造(Deepfake)技术发展迅速,使得篡改或伪造人脸的图像与视频越来越逼真。这对社会公信力、隐私权以及公众人物(如政治家、明星)的声誉造成严重威胁。现有的深度伪造检测方法主要针对“通用场景”——即判断输入人脸是否伪造,而不考虑被伪造的是谁。但现实中,很多目标身份(如公众人物)的真实照片本身是可获取的,这为“基于已知身份的检测”提供了可能。能否利用已知人物的真实人脸信息,来实现更精准、可解释的伪造检测?

图1 伪造人脸在局部人脸属性上的小差异

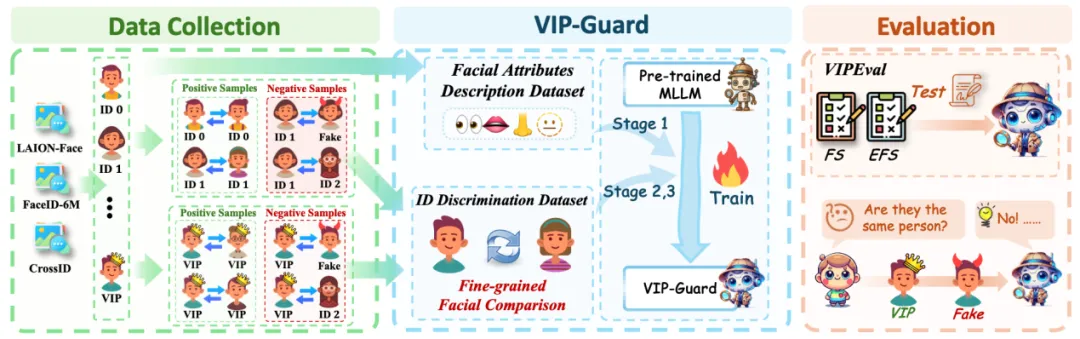

我们观察到深度伪造人脸在全局与局部特征上均存在细微差异(见图1)。据此,我们将身份已知的深度伪造检测任务重新定义为细粒度人脸识别问题,并提出VIPGuard ——一个基于多模态大语言模型(MLLM)的深度伪造检测框架,旨在保护特定身份(VIP)免受Deepfake攻击,VIPGuard整体的Pipeline见图2。

图2. VIPGuard的整体Pipeline示意图

VIPGuard框架引入了一个三阶段训练策略(见图3):(1)人脸属性理解:增强MLLM识别与描述人脸局部结构特征(如眼形、法令纹、肤色等)的能力(2)通用身份判别:通过对比不同人脸图像,提升 MLLM 的细粒度身份区分能力,使模型能够识别高度相似的人脸并判断两张人脸是否为同一人,同时输出可解释的分析理由。(3)特定用户定制:冻结MLLM主体参数,为每个需要保护的VIP用户训练一个专属的VIP Token,用于存储该用户独有的面部特征,实现个性化且高效的伪造检测。

图3 VIPGuard的三阶段训练策略

此外,为了更加全面地验证已知身份条件下的深度伪造方法的性能,我们提出了一个全新的基准VIPEval(见图4),包含22个身份的7种换脸方法与7种全生成人脸方法。

图4 VIPEval的示意图,包含了更多高质量图像

表1和表2给出了定量实验结果,可以看出,VIPGuard在不同类型的人脸伪造方法上均表现出色,显著优于其他对比方法,取得了当前最优的检测性能。

表1 VIPEval 基准下面部互换检测任务的泛化性能(AUC/EER)评估

表2 VIPEval 基准下面部全合成检测任务的泛化性能(AUC/EER)评估

论文信息

该研究工作已被NeurIPS 2025接收,作者为深圳大学的林凯清、周越、林昱臻、李伟祥、李斌(通讯作者),北京大学的晏志远、李昊,以及腾讯优图实验室的张克越、姚太平(通讯作者)、丁守鸿。

Kaiqing Lin, Zhiyuan Yan, Ke-Yue Zhang, Li Hao, Yue Zhou, Yuzhen Lin, Weixiang Li, Taiping Yao, Shouhong Ding, Bin Li. Guard Me If You Know Me :Protecting Specific Face-Identity from Deepfakes. In 39th Conference on Neural Information Processing Systems (NeurIPS 2025).

供稿:林凯清、李斌

义务编辑与校对:薛禹良博士